概要

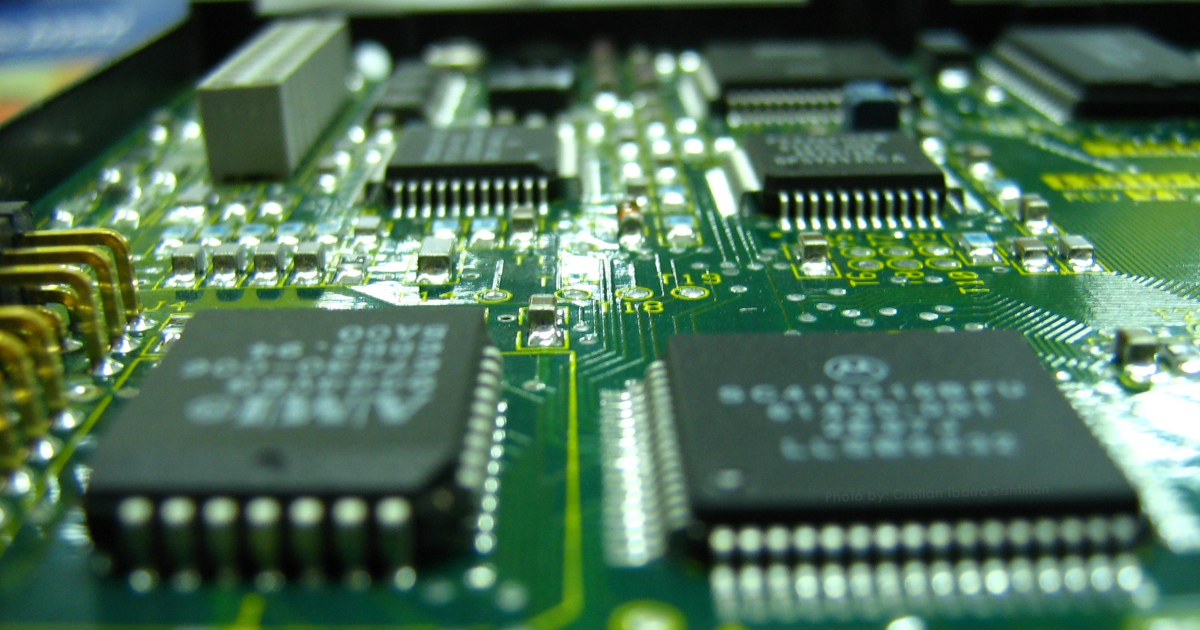

GPU(Graphics Processing Unit)は、ゲームや映像の描画処理のために開発された半導体チップです。しかし、現在では、AIの学習・推論を担う中核部品として世界中のデータセンターに大量導入されています。なぜゲーム用チップが、AIの心臓部になったのか。その理由は、GPUが持つ「並列処理」という特性にあります。この構造が、AIの計算方法と見事に一致したことが、現在のAIブームを技術面で支えています。

重要ポイント

AIの計算は「大量の単純処理」の集まり AIがデータを学習するとき、行列計算と呼ばれる「数字の掛け算・足し算を大量に繰り返す」処理が中心になります。1つの複雑な問題を解くよりも、単純な計算をとにかく大量にこなす必要があります。CPUはこうした大量の単純処理が苦手ですが、GPUは数千〜数万の処理コアを使って同時並列で計算できるため、AIと相性が抜群です。

GPUの「並列処理」がAI学習を劇的に速くした 2012年、GPUを使ってAIの画像認識精度が劇的に向上したことが転換点でした。それまでCPUで数週間かかっていたAI学習が、GPUを使うと数日で完了するようになりました。この発見がAI研究を一気に加速させ、GPUをAIインフラの標準部品へと押し上げました。

HBMとの組み合わせがさらに性能を引き上げる AIの処理ではGPUの演算速度だけでなく、データを供給するメモリの速度も重要です。HBM(広帯域メモリ)をGPUに組み合わせることで、データの読み書き速度が大幅に向上します。最新のAI用GPUにはHBMが必ずセットで搭載されており、GPU・HBM・半導体製造装置の需要が連動して動く構造になっています。

HBMとは →AI用GPUに欠かせない高速メモリの仕組みと、注目される理由を解説しています。

GPUがAIの心臓部になった理由

CPUとGPUの違いを工場に例えると、CPUは「何でもできる熟練工が数人いる工場」、GPUは「単純作業を専門にする作業員が何万人もいる工場」です。複雑な判断が必要な仕事はCPUの熟練工が適していますが、「同じ計算を何百万回も繰り返す」というAIの学習処理には、GPUの大量の作業員が圧倒的に向いています。

GPUとは →並列処理の仕組みから種類まで、GPUの基本をわかりやすく解説しています。

ChatGPTのような大規模言語モデルを学習させるには、数千億個のパラメーター(数値)を何度も更新する計算が必要です。この計算量は膨大で、GPUを数百〜数千台並べたクラスターを使って初めて現実的な時間で完了します。また、学習だけでなく「推論」(すでに学習済みのAIが質問に答える処理)にも大量のGPUが必要です。世界中のユーザーが同時にAIを使う現在、クラウド企業は推論用にも莫大な数のGPUを導入し続けています。Microsoft・Google・Amazonが毎年数兆円規模の設備投資を行っている大きな理由のひとつがここにあります。

データセンターGPUとは →クラウド企業が大量導入するデータセンター向けGPUの役割と市場を解説しています。

AI半導体市場を牽引するNVIDIA

現在、AI向けGPU市場で圧倒的なシェアを持つのがNVIDIAです。CUDAと呼ばれる独自のソフトウェア基盤がAI開発者の標準環境として定着しており、ハードとソフトの両面で他社の追随を許さない強みを持っています。AI投資を考える上で、NVIDIAの動向は欠かせない視点です。

AIの処理に特化して設計されたAI半導体も急速に台頭しています。GoogleのTPUやAmazonの独自チップなど、クラウド大手が自社開発を加速しており、GPU一強の構図に変化が生まれつつあります。

NVIDIAとは →AI時代を支える半導体企業NVIDIAの強みと事業構造を解説しています。

AI半導体とは →GPUにとどまらないAI専用チップの種類と競争構図をわかりやすく解説しています。